隨著大數據技術的迅猛發展,Hadoop已不再是唯一的選擇。雖然Hadoop為分布式數據處理奠定了基礎,但如今市場涌現出許多更高效、更靈活的技術。以下是除Hadoop外,你應該關注的9個大數據技術,這些技術覆蓋數據處理、存儲、分析和實時計算等關鍵領域。

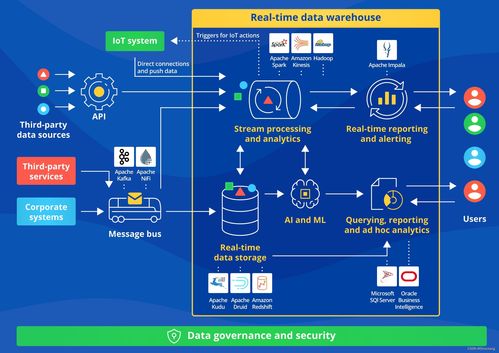

- Spark:作為一個快速、通用的集群計算系統,Spark在內存計算方面表現出色,支持批處理、流處理和機器學習。相比Hadoop的MapReduce,Spark的速度更快,特別適合迭代算法和實時分析。

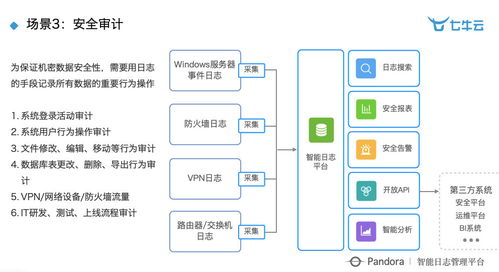

- Kafka:由Apache開發的一個分布式流處理平臺,Kafka用于構建實時數據管道和流應用。它能夠高效處理高吞吐量的數據流,廣泛應用于日志聚合、事件源和消息隊列場景。

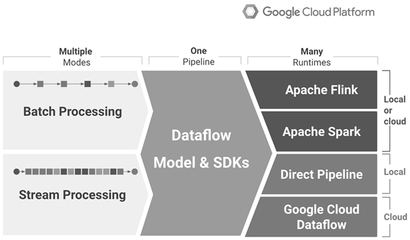

- Flink:一個開源的流處理框架,Flink支持事件驅動型應用,并提供精確一次的處理語義。它在實時數據處理和復雜事件處理方面具有優勢,適合需要低延遲和高可靠性的應用。

- Cassandra:一個高度可擴展的NoSQL數據庫,Cassandra設計用于處理大量數據跨多個數據中心分布。它提供高可用性和無單點故障,適合寫入密集型應用。

- Elasticsearch:一個分布式搜索和分析引擎,基于Lucene構建。Elasticsearch能夠快速索引和查詢大規模數據,常用于日志分析、全文搜索和實時監控。

- Presto:由Facebook開發的分布式SQL查詢引擎,Presto允許在多種數據源(如HDFS、Cassandra和MySQL)上執行快速查詢。它無需將數據移動到單獨系統中,提升了分析效率。

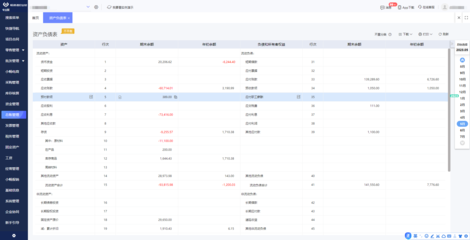

- Snowflake:一個云原生數據倉庫,Snowflake提供彈性的存儲和計算分離架構。它支持多租戶和自動擴展,簡化了大數據管理,適合企業級數據分析和報告。

- Airflow:一個用于編排復雜工作流的平臺,Airflow允許用戶以代碼方式定義、調度和監控數據處理任務。它支持依賴管理和錯誤處理,是數據工程中常用的工具。

- TensorFlow:雖然主要被視為機器學習框架,但TensorFlow在大數據處理中用于構建和部署AI模型。它支持分布式訓練,能夠處理海量數據,推動數據驅動的智能應用。

這些技術各具特色,能夠滿足不同場景下的需求。在選擇時,需根據項目的數據量、實時性要求和資源約束進行評估。大數據生態系統持續演進,掌握這些工具將幫助你在數據處理服務中保持競爭力。